RoboMemory | arxiv 2026.02.04 | Paper Reading

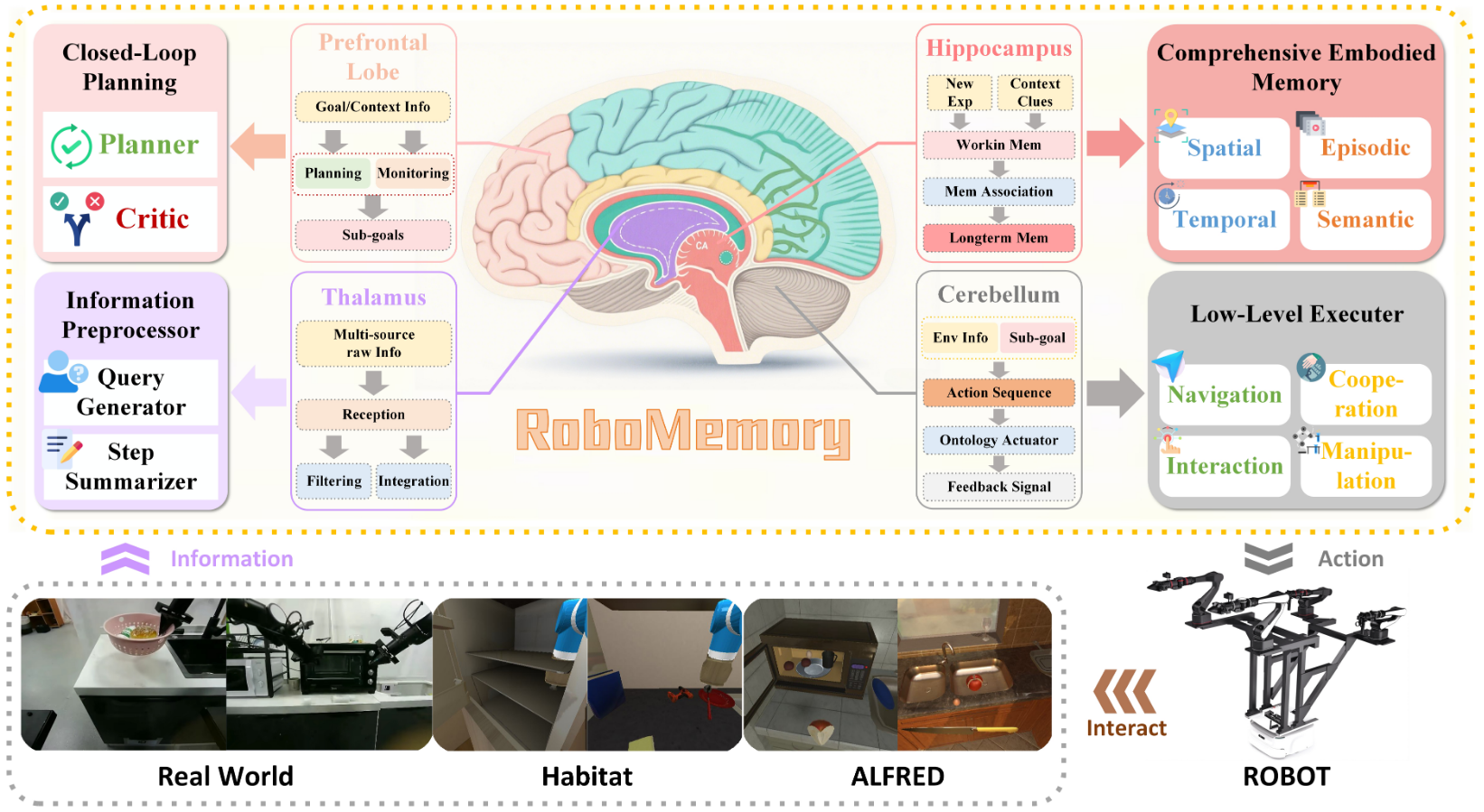

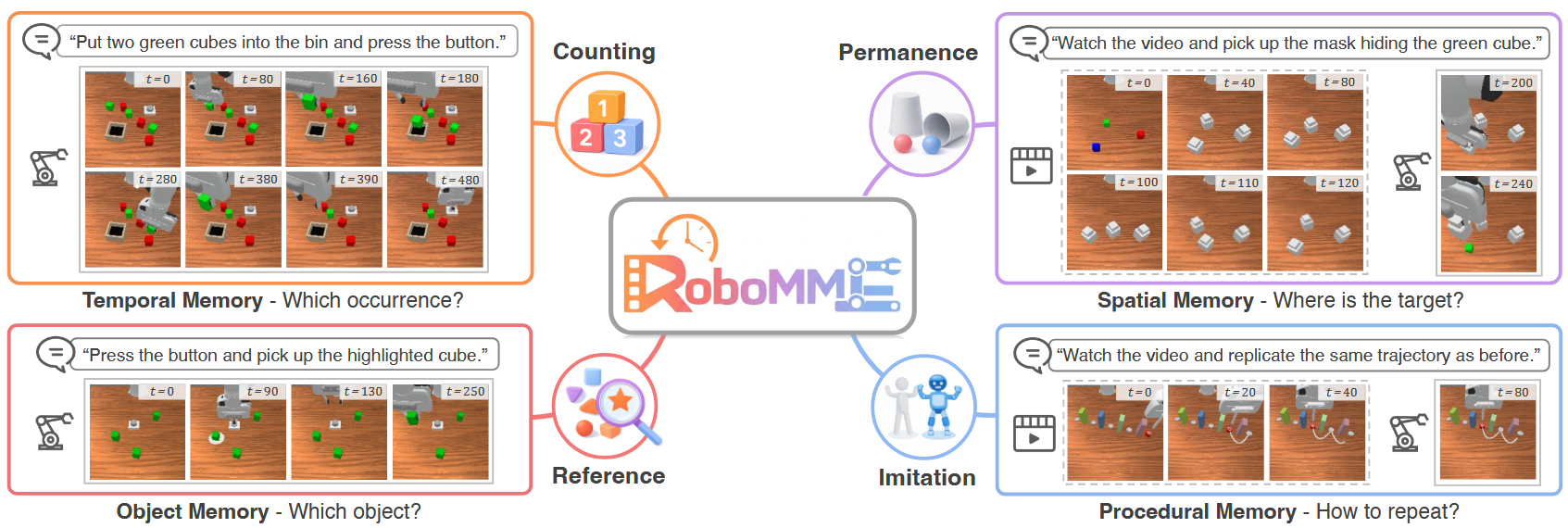

RoboMemory: A Brain-inspired Multi-memory Agentic Framework for Interactive Environmental Learning in Physical Embodied Systems

###RoboMemory 通过模仿大脑结构,设计了四个协同工作的模块,特别是其创新的「终身具身记忆系统」,该系统包含空间、时间、情景和语义四种并行工作的记忆模块,极大地提升了机器人的学习效率和反应速度

| 工作类型(首次/改进) | 技术路线 | 创新点 | 日期 |

|---|---|---|---|

| 首次 | memory framework | memory type | 2026-02-04 |

1.What?

RoboMemory提出了一个框架,模仿大脑结构,设计了四个协同工作的模块,特别是其创新的终身具身记忆系统,该系统包含空间、时间、情景和语义四种并行工作的记忆模块,极大地提升了机器人的学习效率和反应速度。

2.Why?

- 当前机器人在真实世界中面临的几大难题:

- 无法持续学习新知识

- 灾难性遗忘:这是机器学习领域的经典难题。当一个模型学习新知识时,它可能会覆盖或干扰旧的知

- 复杂的记忆系统导致反应迟钝

- 无法忍受的高延迟:为了让机器人不健忘,一个直观的想法是给它一个巨大的记忆库。但问题来了,每次行动前,如果机器人都要把它经历过的所有事情从头到尾「回忆」一遍,那它的反应会慢得令人发指。

- 难以关联不同任务的经验

- 难以捕捉的任务关联:机器人很难理解不同任务之间的内在联系。人类知道「从冰箱里拿苹果」和「从柜子里拿饼干」都包含了「导航到容器」->「打开容器」->「取出物品」这个共通的模式。但机器人可能把它们当成两个完全独立的任务来学习,无法举一反三,导致学习效率低下。

- 在做决策时容易陷入死循环。

- 规划中的死循环:在复杂的动态环境中,机器人需要不断地根据新情况调整计划。但有时,这会导致它在两个或多个选项之间反复横跳,迟迟无法做出最终决定并付诸行动。

- 无法持续学习新知识

3.How?

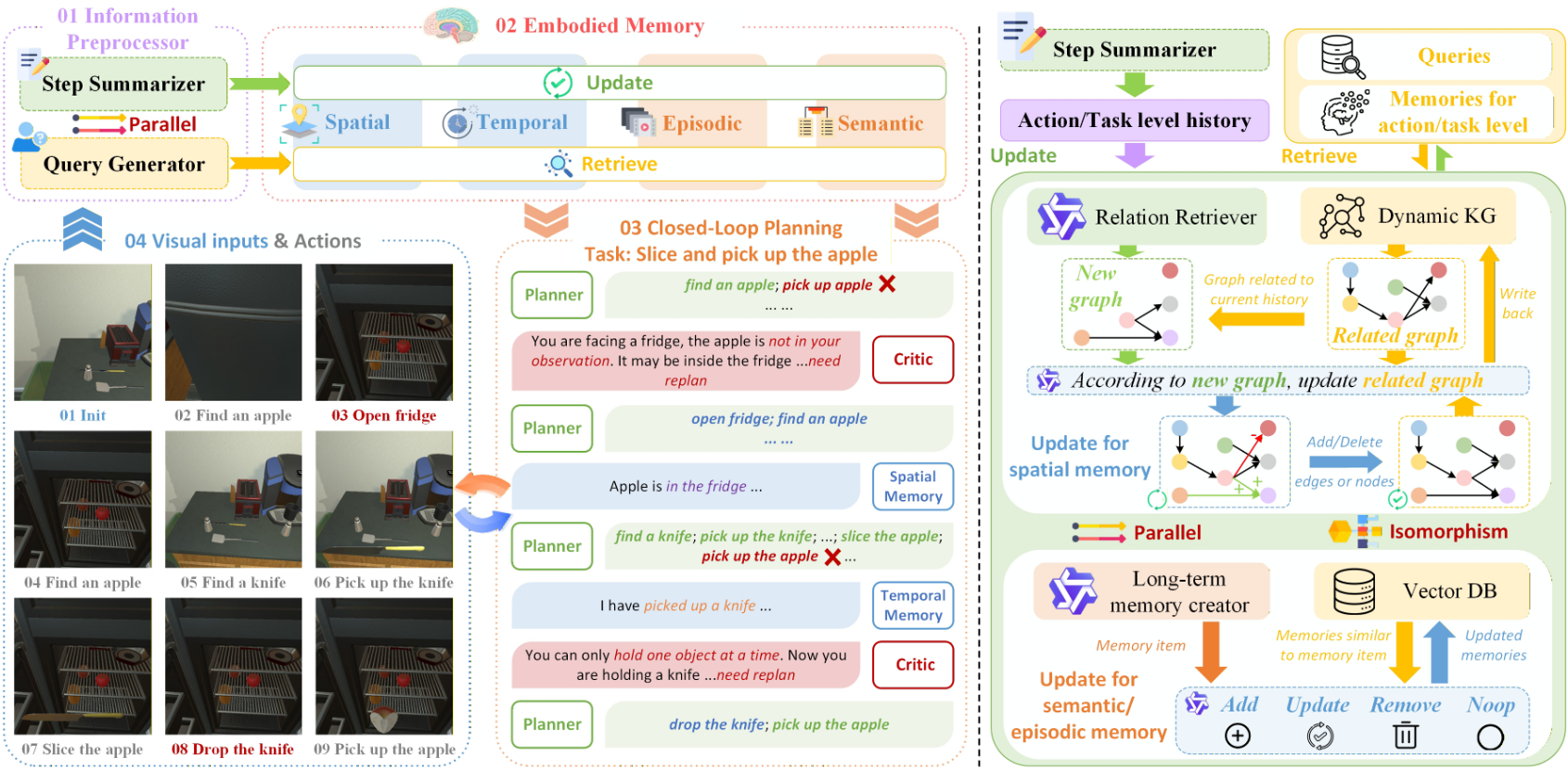

信息预处理器:(并行完成)

- 步骤总结器 : 将刚刚发生的事情(如机器人移动了一下,或者门被打开了)用一句话总结下来,形成工作记忆。例如:「我刚刚把红色的杯子放在了桌子上。」

- 查询生成器: 根据当前的所见所闻,生成一个用于「提问」长期记忆系统的问题。例如:「桌子上除了红色的杯子还有什么?」或者「我上次看到钥匙是在哪里?」

终身具身记忆系统(RoboMemory 最核心的部分)

- 短期记忆 (Temporal Memory) :记录最近发生的几件事。

- 实现: 一个先进先出(FIFO)的缓冲区。你可以把它想象成一个容量有限的便签本,比如只能记 3 件事。当第 4 件事发生时,第 1 件事就会被「挤掉」。但为了不完全丢失信息,在「挤掉」之前,一个语言模型会把这 3 件事总结成一个摘要,再存入更高层的记忆中。这实现了信息的有效压缩和传递。

-

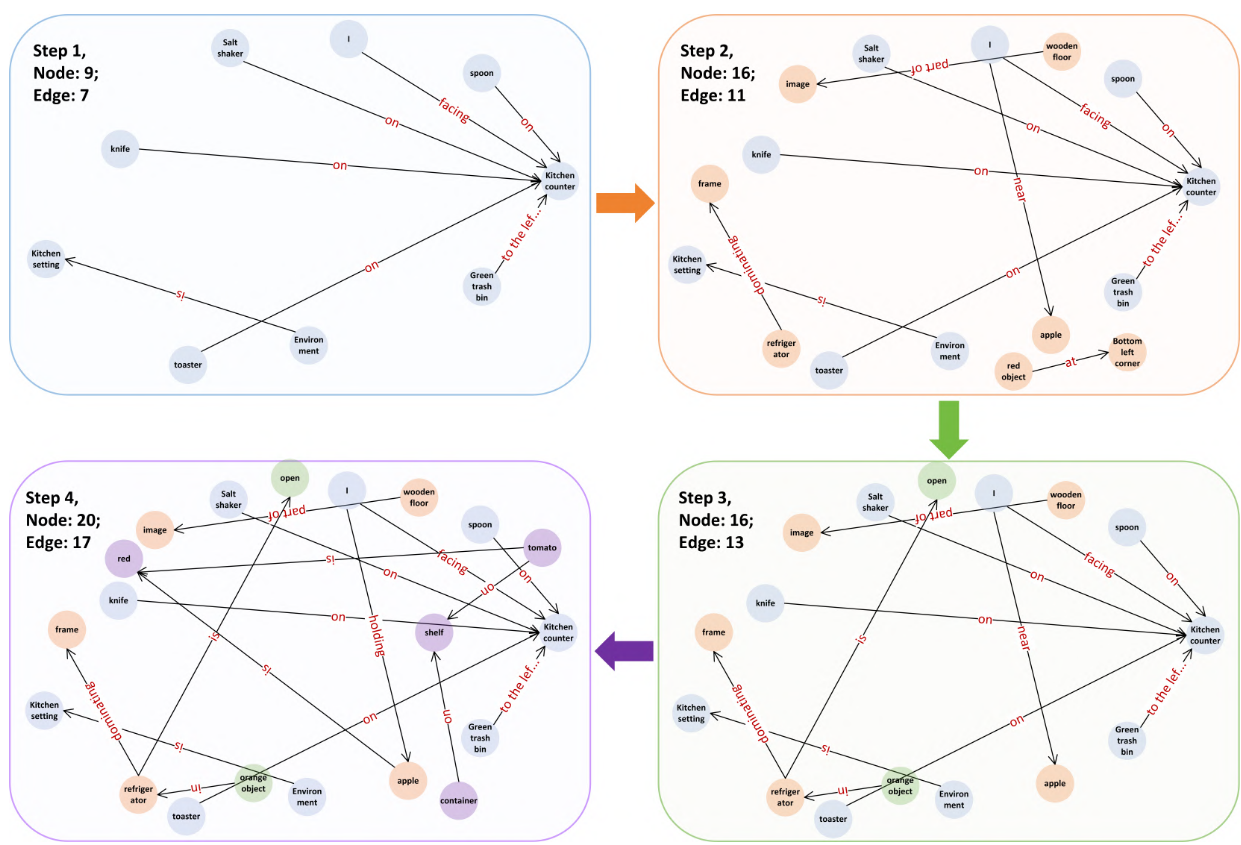

空间记忆 (Spatial Memory) :理解和记忆物体在环境中的位置和相互关系。这是机器人物理交互的基础。

- 实现: 一个动态更新的知识图谱

- 动态更新的挑战: 真实世界是动态的。机器人把苹果从桌上拿到冰箱里,知识图谱就需要实时更新。如果每次更新都要重构整个图,那效率太低了。

- 基于检索的增量式更新算法:当新信息(比如「苹果现在在冰箱里」)进来时,系统不会去动整个庞大的知识图谱。它会先检索出与「苹果」和「冰箱」相关的局部子图,然后在这个小范围内进行信息的融合、冲突的解决(比如删除「苹果在桌上」这个旧关系),最后再把这个更新后的小子图合并回主图。

-

情景记忆 (Episodic Memory) : 完整地记录每一次任务的「故事」,包括目标、执行过程、遇到的困难和最终结果(成功或失败)。

- 实现: 每个任务结束后,系统会将整个过程打包成一个「情景记忆实体」,存储在一个使用 RAG 技术的数据库里。当未来遇到相似任务时,机器人可以「翻阅」这本日记,寻找可借鉴的经验。

-

语义记忆 (Semantic Memory) :从多次的情景记忆中提炼出通用的知识、规律和技能。这是实现「举一反三」的关键。

- 实现: 在任务结束后,一个专门的模块会分析刚刚发生的情景,从中总结出成功的关键因素或失败的根本原因,形成抽象的「语义知识」,同样存入 RAG 数据库。比如,机器人可能会学到:「玻璃门通常是推开的,而木门通常是拉开的」,或者「拿起装满水的杯子时,动作要慢一点」。

闭环规划模块:

- 实现: 在任务结束后,一个专门的模块会分析刚刚发生的情景,从中总结出成功的关键因素或失败的根本原因,形成抽象的「语义知识」,同样存入 RAG 数据库。比如,机器人可能会学到:「玻璃门通常是推开的,而木门通常是拉开的」,或者「拿起装满水的杯子时,动作要慢一点」。

规划者 - 评论家 (Planner-Critic) 机制

- 规划者 (Planner): 根据当前任务目标和从记忆系统中检索到的信息,制定一个初步的多步骤行动计划。例如:

1. 走向冰箱 -> 2. 打开冰箱 -> 3. 拿出牛奶。 - 评论家 (Critic): 在执行每一步之前,它会像一个严谨的监工,重新审视这一步在最新的环境状态下是否还合理。如果机器人走到冰箱前,发现冰箱门已经被别人打开了,评论家就会发现「打开冰箱」这一步是多余且错误的,于是它会立即「喊停」,要求规划者根据新情况重新规划。

原始的 Planner-Critic 机制有个缺陷。如果评论家过于「挑剔」,一直对规划者的计划不满意,机器人就会陷入「重新规划 ->被否决 ->再重新规划」的死循环,卡住不动。RoboMemory 做了一个简单而有效的修改:计划的第一步不经过评论家审核,直接执行。这保证了机器人至少能动起来,打破僵局,避免「分析瘫痪」。虽然这像个小「HACK」,但在工程实践中非常有效。

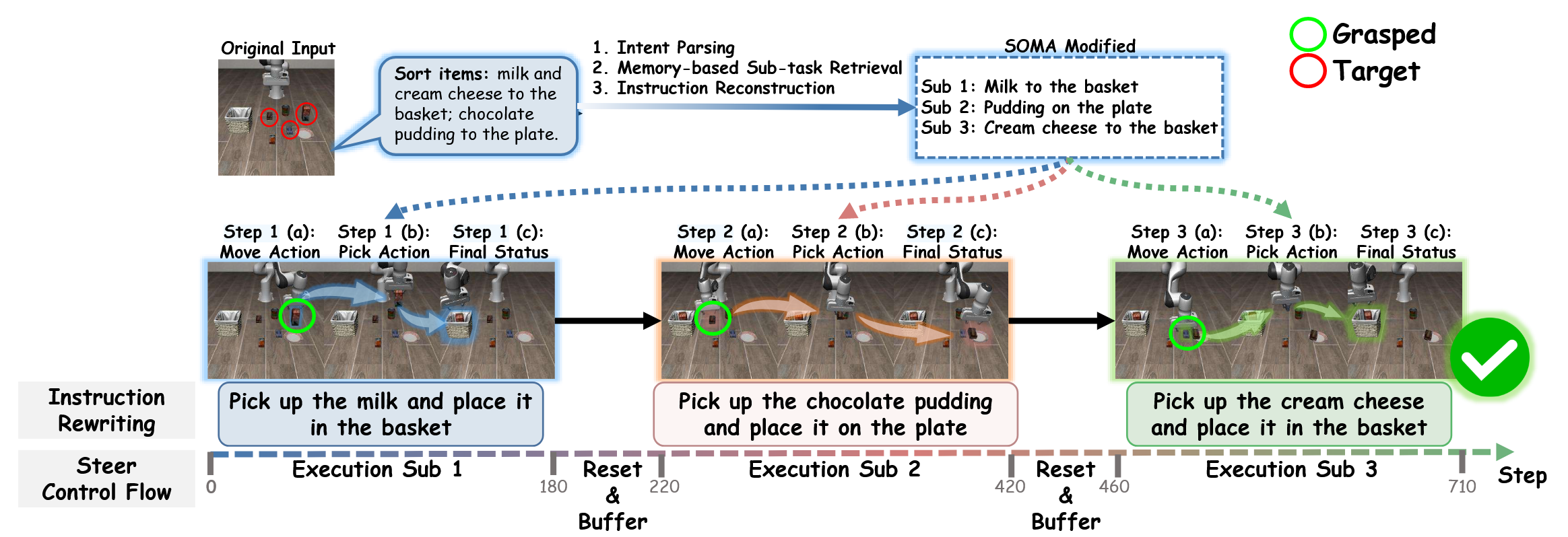

底层执行器:

负责将规划模块发出的高层抽象指令(如 pick_up(milk)),翻译成机器人机械臂和底盘可以执行的、精确的电机控制信号。在真实世界的实验中,研究者们使用了一个名为

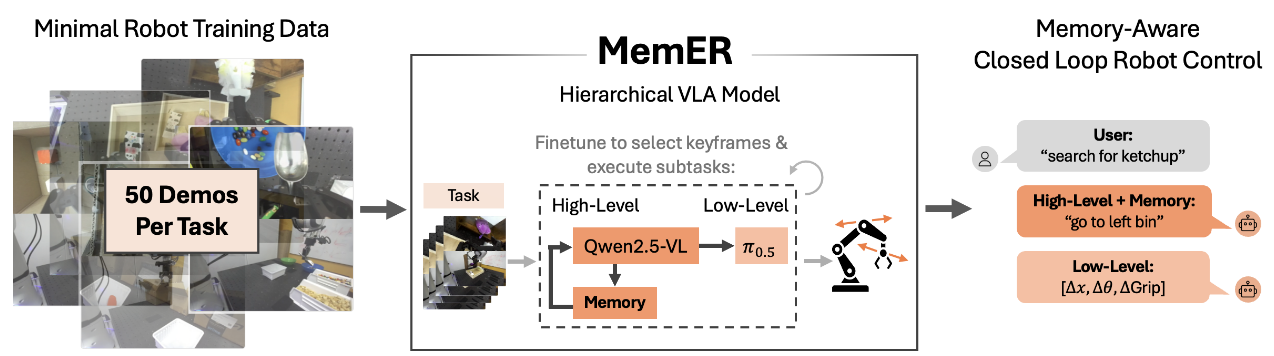

特别要说的是作者做了真机实验验证模型的终身学习的能力

他们让机器人执行 15 个不同的任务,每个任务连续执行两次,中间不清除或重置机器人的长期记忆。如果机器人真的从经验中学习了,那么第二次尝试的成功率应该会高于第一次

4.Takeaways:

- 高效并行记忆架构:RoboMemory 提出了模仿人脑、并行处理空间、时间、情景、语义四类记忆的架构,有效解决了复杂记忆系统的高延迟问题,为机器人智能体设计提供了模块化、并行化的新范式。

- 动态知识图谱更新:创新性地提出了基于检索的增量式知识图谱更新算法,使机器人能在动态环境中高效维护空间关系,推动了机器人空间推理和物理世界理解能力的提升。

- 终身学习实证:在真实厨房环境中验证了机器人终身学习的可行性,证明机器人能从过往经验持续提升任务成功率,增强了社区对机器人终身学习的信心。

- 框架对模型能力的放大:实验显示,RoboMemory 框架能显著提升底层模型性能,甚至超越顶级闭源模型,强调了优秀智能体框架对模型能力释放的巨大作用。

局限性&未来工作:

- 规划能力瓶颈:任务失败主要源于规划错误,说明即使记忆系统完善,底层 VLM 模型的推理与规划能力仍是整体性能的天花板,需进一步提升大模型的逻辑与因果推理能力。

- 知行脱节问题:高层「大脑」规划与底层「身体」执行存在脱节,抽象指令在物理执行中易受环境复杂性影响,未来需加强高层与底层的协同与交互,实现「大脑 - 身体」一体化进化。

- 泛化性与鲁棒性待提升:虽有真实环境验证,但实验场景受控,面对更复杂、开放的家庭环境时,感知、知识图谱扩展及大规模记忆管理等方面的鲁棒性和效率仍需突破。

RoboMemory | arxiv 2026.02.04 | Paper Reading