ReMem | arxiv 2026.03.13 | Paper Reading

ReMem: Empowering Vision-Language-Action Model with Memory via Dual-Level Recurrent Queries

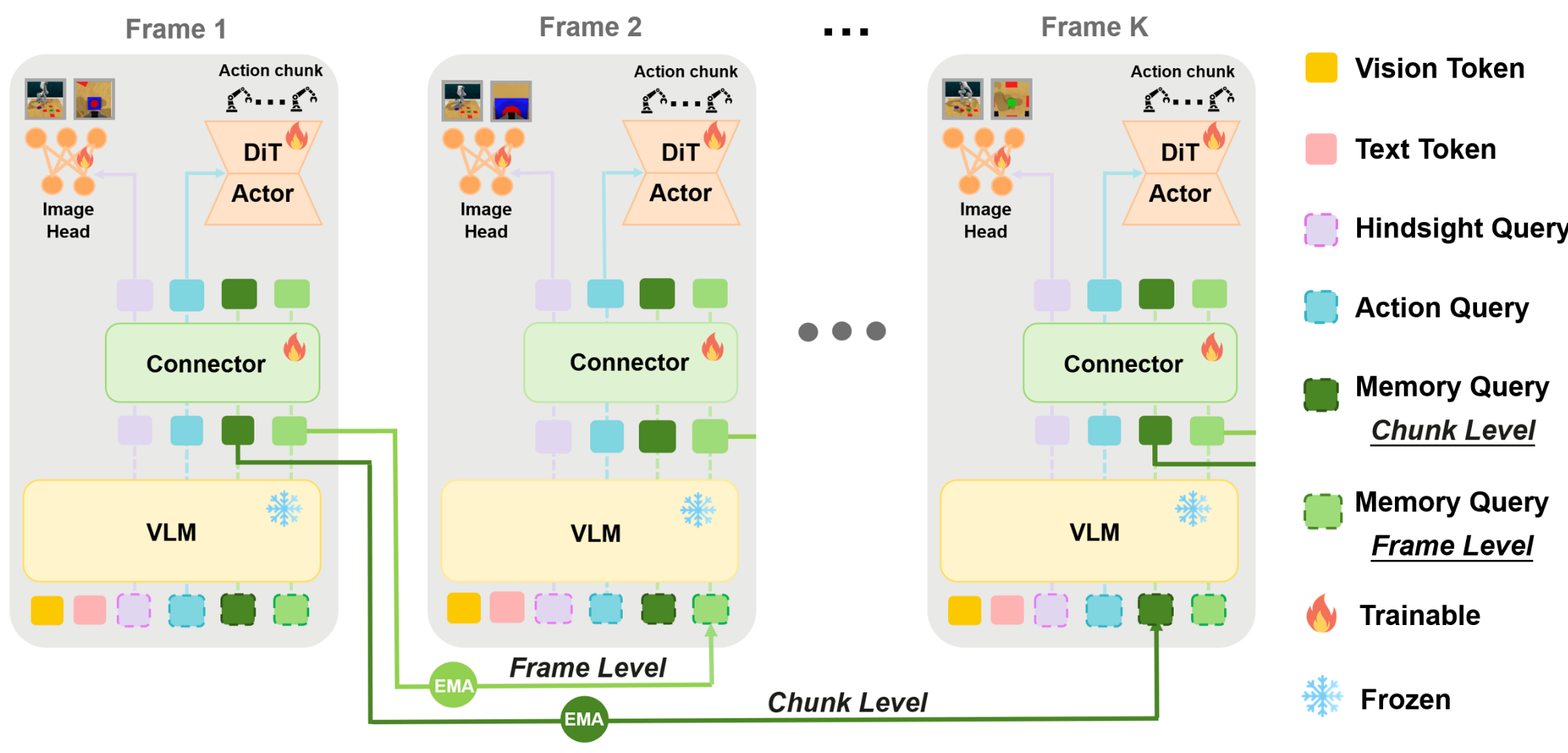

本文提出ReMem-VLA——一种配备两组可学习查询的循环记忆VLA模型:帧级循环记忆查询用于在连续帧间传递信息以支持短期记忆,块级循环记忆查询用于跨时间块传递上下文以实现长期记忆。这些查询通过端到端训练实现相关上下文的动态聚合与维护,在无需额外训练或推理成本的情况下隐式引导模型决策。此外,为增强视觉记忆,我们提出历史观测预测作为辅助训练目标。

| 工作类型(首次/改进) | 技术路线 | 创新点 | 日期 |

|---|---|---|---|

| 改进 | Memory VLA | Memory Architecture | 2026-03-13 |

1.What?

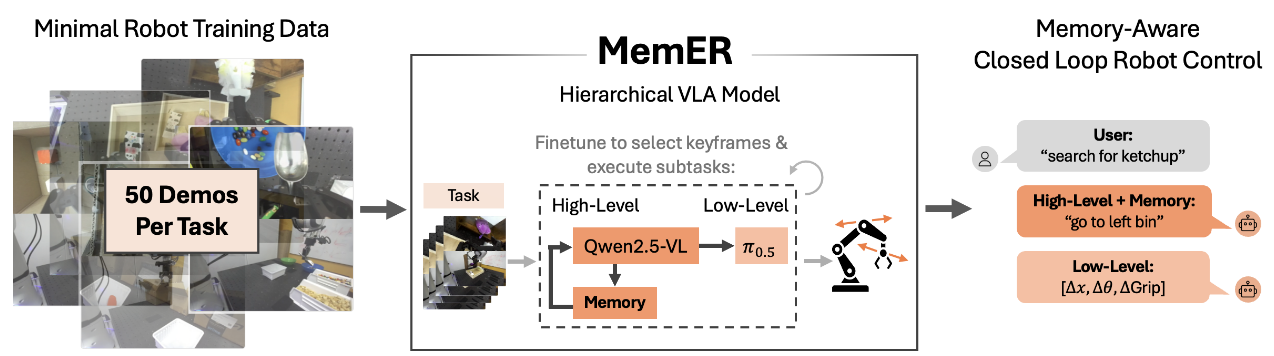

ReMem-VLA,一种新颖的视觉语言动作模型架构,能够促进隐式任务相关记忆的持续提取与积累。我们方法的核心是将可学习的循环记忆查询集成到视觉语言动作模型中,使模型能够基于当前观测与历史背景的协同表征进行每次预测。为捕捉多尺度时序因果性,我们设计了一种双层循环查询方案:1) 一组帧级循环记忆查询,通过视觉语言模型捕捉当前帧的上下文,并原位融合到下一帧的查询中,形成一个在不增加序列长度的情况下跨帧传播短期记忆的循环回路;2) 一组块级循环记忆查询,以更粗的时间粒度在更长的时间间隔内更新,灵感来源于[9, 10]——与每步更新且易覆盖早期上下文的帧级查询不同,块级查询在更长间隔内累积信息,实现超越帧级循环所能保持的稳定长期记忆留存。两组循环查询集均通过固定的、无梯度的循环路径(第3.2节)而非可学习的循环动态进行更新。此设计使循环查询能够学习提取和存储哪些任务相关信息作为记忆,而记忆的传播方式是固定且非学习的。该设计赋能视觉语言动作模型有效关联短期与长期上下文,从而提升其在依赖记忆的操作任务上的性能。

此外,我们进一步引入过去观测预测,通过重建先前的观测来增强视觉记忆留存。具体而言,视觉语言模型主干联合处理视觉观测和语言指令,使用四种类型的可学习查询:(1) 用于短期记忆的帧级循环查询;(2) 用于长期记忆的块级循环查询;(3) 用于预测未来动作片段的、条件化至动作扩散模块的动作查询;(4) 条件化至图像头部的后见查询。

2.Why?

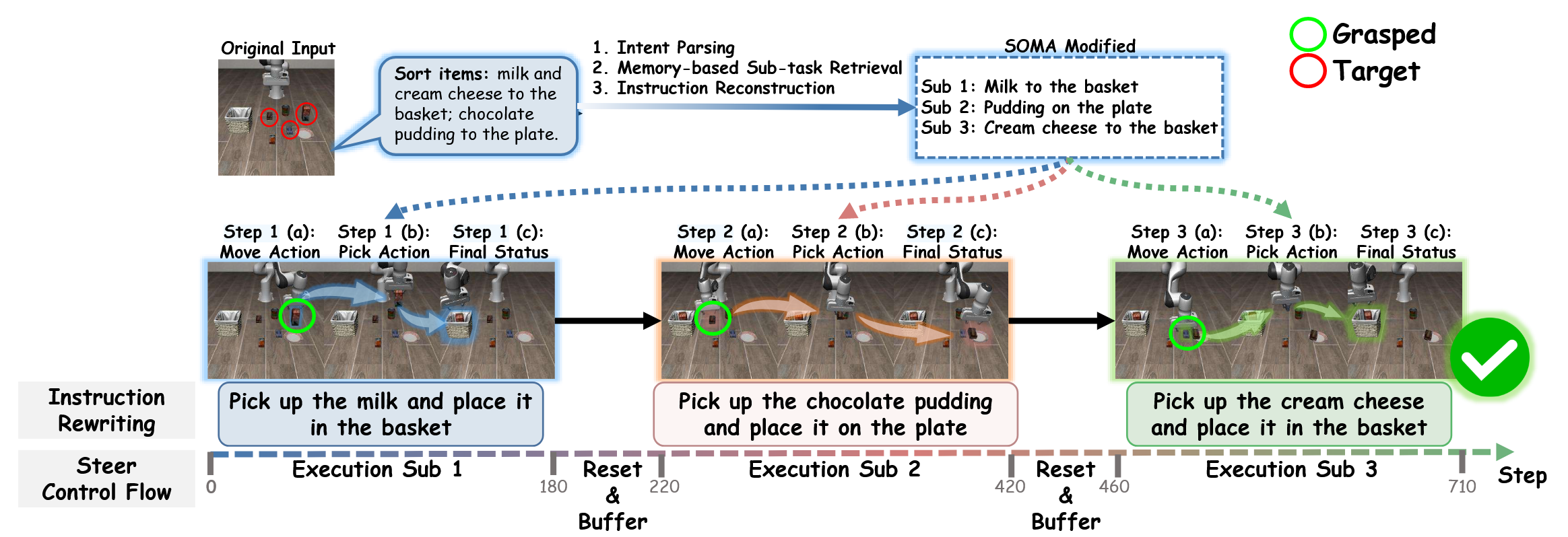

基于检索的方法严重依赖强线索的存在,并在规模扩大时易受干扰;扩展视野的方法无法处理超出上下文窗口的任务;基于点或关键帧的记忆过度简化环境状态,且受限于外部基础模型的可靠性。尽管[11, 33]将RNN式循环机制引入视觉语言动作模型,但二者均未展示长期记忆能力

3.How?

我们将ReMem-VLA设计为一个用于机器人操作的端到端框架。该架构包含五个关键组件:(1) 一个冻结的视觉语言模型主干,用于处理多模态输入——RGB观测

视觉语言模型主干与任务特定可学习查询 我们采用 Qwen3VL-2B 这一拥有20亿参数的视觉语言模型作为冻结主干 [53]。在每个时间步,主干通过其视觉编码器处理RGB观测,并通过其文本编码器处理语言指令,生成隐藏状态

双级循环记忆查询 为了实现跨不同时间尺度的记忆能力,我们引入了双级循环查询:用于短期保留的帧级记忆查询

其中

其中

无需梯度的循环更新路径

4.Takeaways:

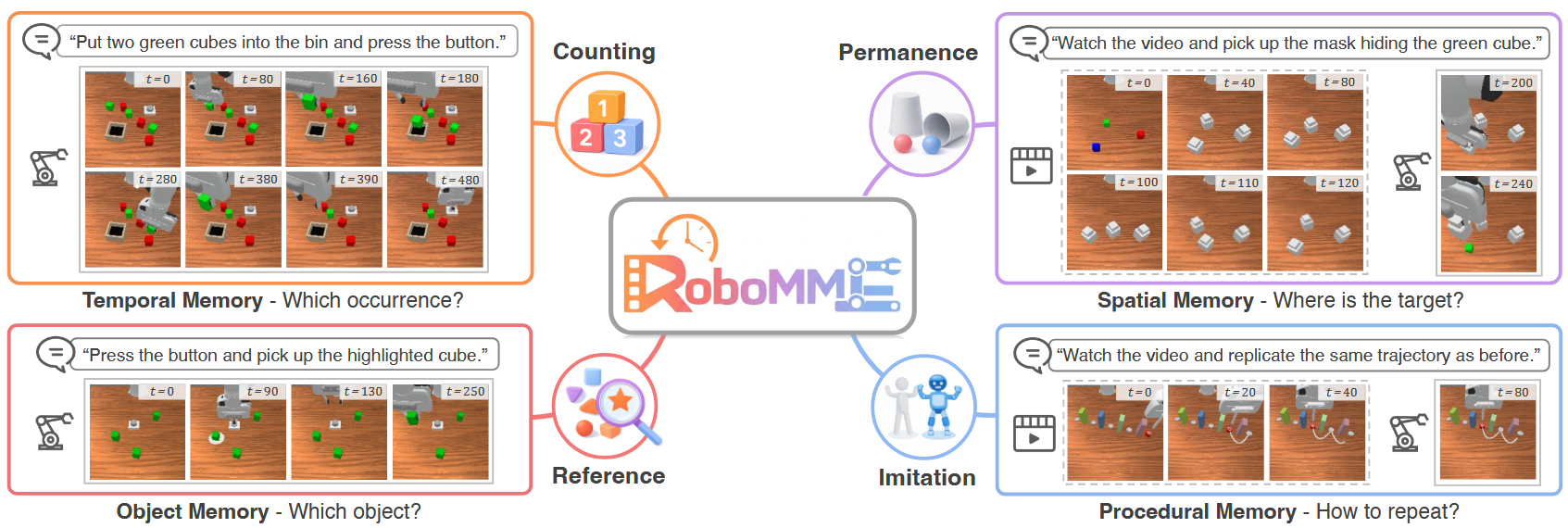

移除所有循环查询会导致记忆能力完全崩溃,所有任务成功率急剧下降;在单层配置中,仅使用帧级查询难以维持长期记忆,导致记忆相关故障比例更高;而仅使用块级查询虽能提升长期记忆保持能力,却因按钮操作需要块级查询无法提供的短期记忆,导致整体成功率降低。双层模型在所有任务中均取得更优性能,表明两个层级的循环查询能为模型提供互补的记忆能力。

过往观察预测对不依赖视觉记忆的任务提升有限,但在视觉记忆密集型的"归还水果"任务中带来显著改善(34% → 82%),特别是在预测片段首帧时。实验结果同时表明,虽然双层级循环查询在空间、时序、片段和序列维度展现出强大的记忆能力,但其在保留视觉细节方面效果较弱,因而受益于过往观察预测。

局限性&未来工作:

尽管具备这些优势,当前模型的局限在于尚未经过大规模机器人数据训练,这可能影响其泛化性能。未来工作包括在大规模数据集上预训练ReMem-VLA,或将本记忆机制整合至现有预训练的视觉语言动作模型中。

ReMem | arxiv 2026.03.13 | Paper Reading